LVS项目背景

1998年5月,由章文嵩组织成立了Linux Virtual Server的自由软件项目,进行Linux服务器集群的开发工作。同时,Linux Virtual Server项目是国内最早出现的自由软件项目之一。

项目的成立目的就是,使用集群技术和Linux操作系统实现一个高性能、高可用的服务器,它具有很好的可伸缩性(Scalability)、可靠性(Reliability)和可管理性(Manageability)。

LVS的体系架构

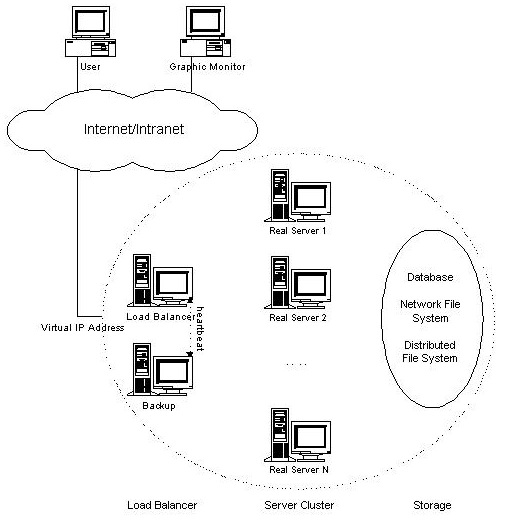

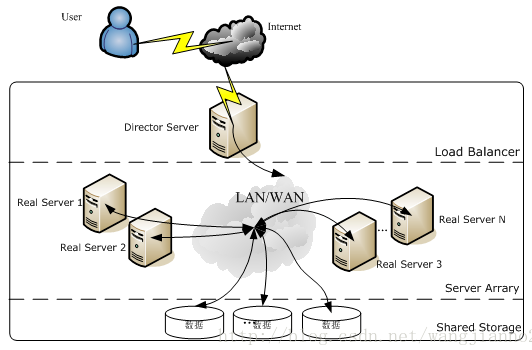

一般来说,LVS集群采用三层结构,其通用的体系结构如下:

LVS集群主要有三层结构:

(1)负载调度器

负载调度器(Load Balancer),也称Director Server,简称DS。它是整个集群对外面的前端机,负责将客户的请求发送到一组服务器上执行,而客户认为服务是来自一个IP地址(我们可称之为虚拟IP地址)上的。调度器是服务器集群系统的唯一入口点(Single Entry Point),它可以采用IP负载均衡技术、基于内容请求分发技术或者两者相结合。在IP负载均衡技术中,需要服务器池拥有相同的内容提供相同的服务。当客户请求到达时,调度器只根据服务器负载情况和设定的调度算法从服务器池中选出一个服务器,将该请求转发到选出的服务器,并记录这个调度;当这个请求的其他报文到达,也会被转发到前面选出的服务器。在基于内容请求分发技术中,服务器可以提供不同的服务,当客户请求到达时,调度器可根据请求的内容选择服务器执行请求。因为所有的操作都是在Linux操作系统核心空间中将完成的,它的调度开销很小,所以它具有很高的吞吐率。

(2)服务器池

服务器池(server pool),也称Real Server,简称RS。它是一组真正执行客户请求的服务器,执行的服务有WEB、MAIL、FTP和DNS等。

(3)共享存储

共享存储(shared storage),它为服务器池提供一个共享的存储区,这样很容易使得服务器池拥有相同的内容,提供相同的服务。

从整个LVS结构可以看出,Director Server是整个LVS的核心,目前,用于Director Server的操作系统只能是Linux和FreeBSD,linux2.6内核不用任何设置就可以支持LVS功能,而FreeBSD作为Director Server的应用还不是很多,性能也不是很好。对于Real Server,几乎可以是所有的系统平台,Linux、windows、Solaris、AIX、BSD系列都能很好的支持。

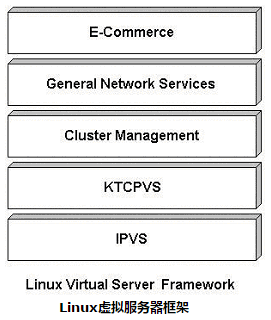

LVS的技术实现

可以利用LVS框架实现高可伸缩的、高可用的Web、Cache、Mail和Media等网络服务。在LVS框架包含三个部分:

(1)包含了三种IP负载均衡技术的IP虚拟服务器软件IPVS,即四层负载均衡

(2)基于内容请求分发的内核Layer-7交换机KTCPVS,即七层负载均衡,也即应用层的转发,目前这个组件在实际中使用的并不多,还不够成熟

(3)集群管理软件,即ipvsadm

KTCPVS是七层交互交换技术,也就是基于应用层来进行调度的目的,比如HTTP,FTP等。这个和IPVS在IP层的调度有很大的区别。

所以说,LVS的调度器有两种调度实现技术,一种是基于IP负载均衡技术的IPVS,一种是基于内容请求分发技术的KTCPVS。

LVS的IPVS模块的三种负载均衡工作模式

IPVS调度器的三种IP负载均衡技术如下:

(1)VS/NAT工作模式

VS/NAT,全称为Virtual Server via Network Address Translation。VS/NAT通过网络地址转换(Network Address Translation)将一组服务器构成一个高性能的、高可用的虚拟服务器。NAT用法本来是因为网络IP地址不足而把内部保留IP地址通过映射转换成公网地址的一种上网方式(原地址NAT)。如果把NAT的过程稍微变化,就可以成为负载均衡的一种方式。原理其实就是把从客户端发来的IP包的IP头目的地址在DR上换成其中一台RS的IP地址并发至此RS,而RS则在处理完成后把数据经过DR主机发回给客户端,DR在这个时候再把数据包的原IP地址改为DR接口上的IP地址即可。期间,无论是进来的流量,还是出去的流量,都必须经过DR。

简单来说,通过网络地址转换,调度器重写请求报文的目标地址,根据预设的调度算法,将请求分派给后端的真实服务器;真实服务器的响应报文通过调度器时,报文的源地址被重写,再返回给客户,完成整个负载调度过程。

VS/NAT技术实施关键点,DS和RS要在同一个VLAN,且RS的缺省网关一定要配置成DS的VIP,RS响应包经过DS,RS不需要连接外网。

(2)VS/TUN工作模式

VS/TUN, 全称为Virtual Server via IP Tunneling。VS/TUN模式类似于VPN的方式,使用网络分层的原理,在从客户端发来的数据包的基础上,封装一个新的IP头标记(不完整的IP头,只有目的IP部)发给RS,RS收到后,先把DR发过来的数据包的头给解开,还原其数据包原样,处理后,直接返回给客户端,而不需要再经过DR。需要注意的是,由于RealServer需要对DR发过来的数据包进行还原,也就是说必须支持IPTUNNEL协议。所以,在RS的内核中,必须编译支持IPTUNNEL这个选项。IPTUNNEL也在Networking Options里面。

简单来说,采用NAT技术时,由于请求和响应报文都必须经过调度器地址重写,当客户请求越来越多时,调度器的处理能力将成为瓶颈。为了解决这个问题,调度器把请求报文通过IP隧道转发至真实服务器,而真实服务器将响应直接返回给客户,所以调度器只处理请求报文。由于一般网络服务应答比请求报文大许多,采用VS/TUN技术后,集群系统的最大吞吐量可以提高10倍。

VS/TUN技术实施关键点,DS和RS不需要在同一个VLAN下,且RS上需要配置VIP,RS响应包不经过DS,RS需要连接外网,RS需要安装ipip模块支持ip隧道技术。

(3)VS/DR工作模式

VS/DR,全称为Virtual Server via Direct Routing。VS/DR通过直接路由实现虚拟服务器。直接路由模式比较特别,很难说和什么方面相似,前2种模式基本上都是工作在网络层上(三层),而直接路由模式则应该是工作在数据链路层上(二层)。其原理为,DR和RS都使用同一个IP对外服务。但只有DR对ARP请求进行响应,所有RS对本身这个IP的ARP请求保持静默。也就是说,网关会把对这个服务IP的请求全部定向给DR,而DR收到数据包后根据调度算法,找出对应的RS,把目的MAC地址改为RS的MAC并发给这台RS。这时RS收到这个数据包,则等于直接从客户端收到这个数据包无异,处理后直接返回给客户端。由于DR要对二层包头进行改换,所以DR和RS之间必须在一个广播域,也可以简单的理解为在同一台交换机上。

简单来说,VS/DR通过改写请求报文的MAC地址,将请求发送到真实服务器,而真实服务器将响应直接返回给客户。同VS/TUN技术一样,VS/DR技术可极大地提高集群系统的伸缩性。这种方法没有IP隧道的开销,对集群中的真实服务器也没有必须支持IP隧道协议的要求,但是要求调度器与真实服务器都有一块网卡连在同一物理网段上。

VS/DR技术实施关键点,DS和RS要在同一个VLAN,且RS上lo网口上要配置VIP,RS响应包不经过DS,RS需要连接外网。

备注:VS/DR模式下,各RS服务器均需要配置上VIP。这是因为经DR转发过来的IP包要被RS接受,则目的IP地址必须是RS的IP地址,所以需要RS在网卡上配置上VIP。但由于VIP已经配置在DS上,所以RS只能将VIP配置在Non-ARP网络设备上,它对外不可见(即不会响应外部的ARP地址解析请求,所以不会与DS IP冲突),只是用于欺骗RS去处理目标地址为VIP的网络数据包。一般来说,RS是将VIP绑定到本地回环接口设备lo上的。另外,VS/TUN模式应该也需要RS绑定VIP,而VS/NAT模式则不需要。

还有一点需要注意的是,DS上有一个连接Hash表中记录每一个连接,当某一个连接的下一个报文到达时,从连接Hash表中可以Hash算出原来的RS机器啦。

另外,alibaba/lvs项目增加了FULLNAT模式,不同于VS/NAT模式,DS和RS可以跨VLAN,且RS不需要连接外网,更灵活一些,但是RS响应包需要经过DS。

LVS的IPVS模块的八种负载调度算法

IPVS调度器的八种负载调度算法如下:

(1)轮叫(Round Robin)

调度器通过“轮叫”调度算法将外部请求按顺序轮流分配到集群中的真实服务器上,它均等地对待每一台服务器,而不管服务器上实际的连接数和系统负载。

(2)加权轮叫(Weighted Round Robin)

调度器通过“加权轮叫”调度算法根据真实服务器的不同处理能力来调度访问请求。这样可以保证处理能力强的服务器处理更多的访问流量。调度器可以自动问询真实服务器的负载情况,并动态地调整其权值。

(3)最少链接(Least Connections)

调度器通过“最少连接”调度算法动态地将网络请求调度到已建立的链接数最少的服务器上。如果集群系统的真实服务器具有相近的系统性能,采用“最小连接”调度算法可以较好地均衡负载。

(4)加权最少链接(Weighted Least Connections)

在集群系统中的服务器性能差异较大的情况下,调度器采用“加权最少链接”调度算法优化负载均衡性能,具有较高权值的服务器将承受较大比例的活动连接负载。调度器可以自动问询真实服务器的负载情况,并动态地调整其权值。

(5)基于局部性的最少链接(Locality-Based Least Connections)

“基于局部性的最少链接”调度算法是针对目标IP地址的负载均衡,目前主要用于Cache集群系统。该算法根据请求的目标IP地址找出该目标IP地址最近使用的服务器,若该服务器 是可用的且没有超载,将请求发送到该服务器;若服务器不存在,或者该服务器超载且有服务器处于一半的工作负载,则用”最少链接”的原则选出一个可用的服务 器,将请求发送到该服务器。

(6)带复制的基于局部性最少链接(Locality-Based Least Connections with Replication)

“带复制的基于局部性最少链接”调度算法也是针对目标IP地址的负载均衡,目前主要用于Cache集群系统。它与LBLC算法的不同之处是它要维护从一个 目标IP地址到一组服务器的映射,而LBLC算法维护从一个目标IP地址到一台服务器的映射。该算法根据请求的目标IP地址找出该目标IP地址对应的服务 器组,按”最小连接”原则从服务器组中选出一台服务器,若服务器没有超载,将请求发送到该服务器,若服务器超载;则按”最小连接”原则从这个集群中选出一 台服务器,将该服务器加入到服务器组中,将请求发送到该服务器。同时,当该服务器组有一段时间没有被修改,将最忙的服务器从服务器组中删除,以降低复制的程度。

(7)目标地址散列(Destination Hashing)

“目标地址散列”调度算法根据请求的目标IP地址,作为散列键(Hash Key)从静态分配的散列表找出对应的服务器,若该服务器是可用的且未超载,将请求发送到该服务器,否则返回空。

(8)源地址散列(Source Hashing)

“源地址散列”调度算法根据请求的源IP地址,作为散列键(Hash Key)从静态分配的散列表找出对应的服务器,若该服务器是可用的且未超载,将请求发送到该服务器,否则返回空。

LVS集群的配置和搭建

ipvsadm是lvs的ipvs模块的配置工具,通过ipvsadm工具可以进行lvs的配置工作。ipvsadm命令的一些常用选项如下:

1 | -A, --add-service #在内核的虚拟服务器列表中添加一条新的虚拟IP记录,也就是增加一台新的虚拟服务器,虚拟IP也就是虚拟服务器的IP地址 |

ipvsadm的一些常用命令操作范例如下:

(1)ipvsadm -A -t 192.168.60.200:80 -s rr -p 600

在内核的虚拟服务器列表中添加一条192.168.60.200的虚拟服务器记录,并且指定此虚拟服务器的服务端口为80,然后指定此虚拟服务器的调度策略为轮询调度,并且在每个RS上的持续服务时间为600秒,即10分钟。

(2)ipvsadm -A -t 192.168.60.188:21 -s wlc

在内核的虚拟服务器列表中又添加了一条192.168.60.188的虚拟服务器,此虚拟服务器的服务端口为21,即FTP服务。使用的调度策略为wlc,即加权最少链接算法。

(3)ipvsadm -a -t 192.168.60.200:80 -r 192.168.60.132:80 –g和ipvsadm -a -t 192.168.60.200:80 -r 192.168.60.144:80 –g

以上两条设置表示在虚拟服务器192.168.60.200中添加两条新的RS记录,两个RS的IP分别为192.168.60.132和192.168.60.144,参数“-g”指定了虚拟服务器的工作模式为直接路由模式,即DR模式。 这样设置完毕后,当用户访问192.168.60.200的80服务时,LVS会根据设置的调度策略和路由模式将请求分配到192.168.60.132以及192.168.60.144的80端口。

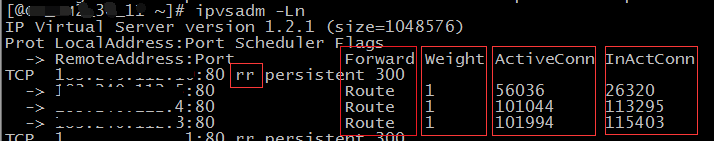

(4)ipvsadm -Ln

查询一台机器上的所有虚拟服务器。显示结果如下:

备注:Scheduler=rr是对RS的调度算法为Round Robin轮叫算法。Forward=Route表示使用的是直接路由Direct Routing工作模式。ActiveConn是处于ESTABLISHED状态的TCP连接数。InActConn是指除了ESTABLISHED以外的,所有的其它状态的TCP连接。有一点需要注意的是,从LVS里看的ActiveConn会比在真实机上通过netstat看到的ESTABLISHED一般会多一些。这是因为LVS自身有一个默认超时时间。可以用ipvsadm -L --timeout查看,默认是900 120 300(分别是TCP/TCPFIN/UDP的超时时间)。也就是说一条TCP的连接经过LVS后,LVS会把这条记录保存15分钟,而不管这条连接是不是已经失效。

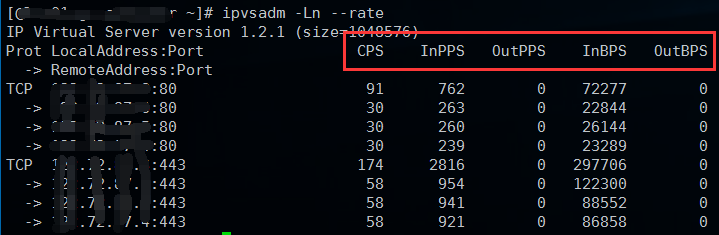

(5)ipvsadm -Ln --rate

查看LVS转发速率相关指标。命令执行效果如下:

其中,CPS表示每秒连接数,InPPS表示每秒入包个数,OutPPS表示每秒出包个数,InBPS表示每秒入流量(单位字节),OutBPS表示每秒出流量(单位字节)。

LVS集群的高可用性

LVS集群的高可用性体现在两个方面:

(1)Server Cluster/Server Array中的单台RS故障自动容灾

在调度器上有资源监测进程来时刻监视各个服务器结点的健康状况。当服务器对ICMP ping不可达时或者探测她的网络服务在指定的时间没有响应时,资源监测进程通知操作系统内核将该服务器从调度列表中删除或者失效。这样,新的服务请求就不会被调度到坏的结点。资源监测进程能通过电子邮件或传呼机向管理员报告故障。一旦监测进程到服务器恢复工作,通知调度器将其加入调度列表进行调度。另外,通过系统提供的管理程序,管理员可发命令随时可以将新机器加入服务来提高系统的处理性能,也可以将已有的服务器切出服务,以便对服务器进行系统维护。

(2)调度器的主备容灾

前端的调度器有可能成为系统的单一失效点(Single Point of Failure)。一般来说,调度器的可靠性较高,因为调度器上运行的程序较少而且大部分程序早已经遍历过,但我们不能排除硬件老化、网络线路或者人为误操作等主要故障。为了避免调度器失效而导致整个系统不能工作,我们需要设立一个从调度器作为主调度器的备份。两个心跳(Heartbeat)进程分别在主、从调度器上运行,它们通过串口线和UDP等心跳线来相互定时地汇报各自的健康状况。当从调度器不能听得主调度器的心跳时,从调度器通过ARP欺骗(Gratuitous ARP)来接管集群对外的Virtual IP Address,同时接管主调度器的工作来提供负载调度服务。当主调度器恢复时,这里有两种方法,一是主调度器自动变成从调度器,二是从调度器释放Virtual IP Address,主调度器收回Virtual IP Address并提供负载调度服务。

当主调度器失效时,主调度器上所有已建立连接的状态信息将丢失,已有的连接会中断。客户需要向重新连接,从调度器才会将新连接调度到各个服务器上,这对客户会造成一定的不便。为此,IPVS调度器在Linux内核中实现一种高效状态同步机制,将主调度器的状态信息及时地同步到从调度器。当从调度器接管时,绝大部分已建立的连接会持续下去。

目前,keepalived,heartbeat都支持IP漂移,来实现LVS调度器的高可用性。

学习资料来源于:

http://www.linuxvirtualserver.org/zh/

http://ixdba.blog.51cto.com/2895551/552947

http://ixdba.blog.51cto.com/2895551/554029

http://ixdba.blog.51cto.com/2895551/554799

http://ixdba.blog.51cto.com/2895551/555738

http://blog.51cto.com/blief/1745134

http://www.cnblogs.com/oldjiang/archive/2013/02/01/LVS-Nat-Tun-Dr.html